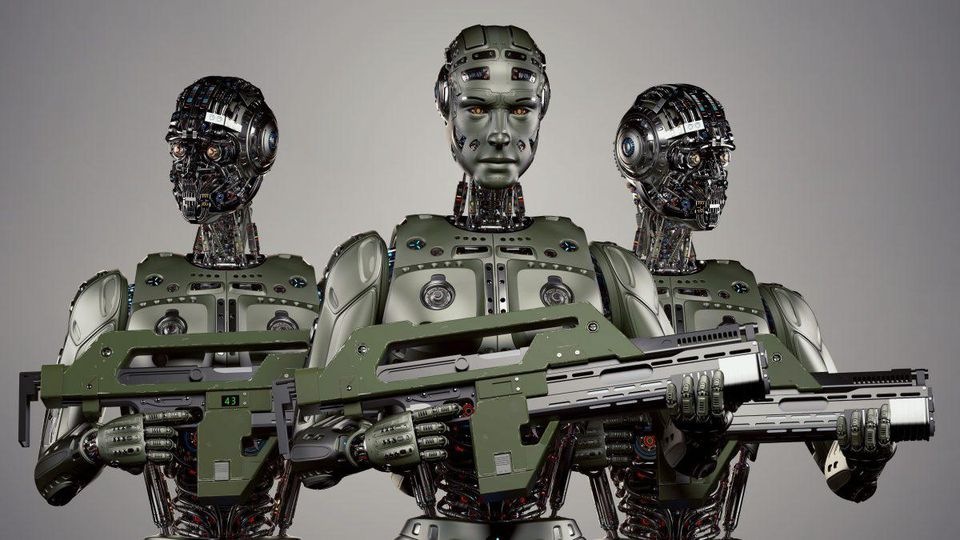

ผลกระทบทางจริยธรรมของการพัฒนาอาวุธอิสระ

ในขณะที่เทคโนโลยีก้าวหน้าอย่างต่อเนื่อง ความกังวลก็เพิ่มขึ้นเกี่ยวกับบทบาทของปัญญาประดิษฐ์ (AI) ในสงครามสมัยใหม่ อาวุธอิสระซึ่งใช้ AI ในการตัดสินใจโดยปราศจากการแทรกแซงของมนุษย์ กำลังได้รับการพัฒนาโดยกองทัพและบริษัทเอกชนทั่วโลก อย่างไรก็ตาม ผู้เชี่ยวชาญหลายคนเตือนว่าการพัฒนาอาวุธเหล่านี้ทำให้เกิดข้อกังวลด้านจริยธรรมอย่างร้ายแรง และอาจส่งผลร้ายแรงหากไม่ได้รับการควบคุมอย่างรอบคอบ

หนึ่งในข้อกังวลหลักเกี่ยวกับอาวุธอิสระคือการขาดความรับผิดชอบ หากปราศจากการกำกับดูแลของมนุษย์ อาวุธเหล่านี้อาจทำการตัดสินใจที่ละเมิดกฎหมายระหว่างประเทศหรือบรรทัดฐานทางจริยธรรมที่ยอมรับได้ ตัวอย่างเช่น โดรนไร้คนขับอาจพุ่งเป้าไปที่พลเรือนอย่างผิดพลาดหรือไม่สามารถแยกแยะระหว่างผู้ต่อสู้และผู้ไม่ต่อสู้ ในสถานการณ์เช่นนี้ ใครจะรับผิดชอบต่อความเสียหายที่เกิดขึ้น การขาดความรับผิดชอบนี้เกี่ยวข้องกับศักยภาพของอาวุธอิสระในการทำงานโดยไม่มีอำนาจหรือการสื่อสารที่ชัดเจน

ความกังวลด้านจริยธรรมอีกประการหนึ่งที่เกิดจากอาวุธอิสระคือศักยภาพของพวกมันในการทำให้ความไม่เท่าเทียมและอคติที่มีอยู่คงอยู่ต่อไป อัลกอริทึมของ AI นั้นไม่มีอคติพอๆ กับข้อมูลที่ได้รับการฝึกฝน และหากข้อมูลนั้นมีอคติ การตัดสินใจที่เป็นผลก็จะเป็นเช่นนั้นเช่นกัน สิ่งนี้อาจนำไปสู่การใช้อาวุธอัตโนมัติที่พุ่งเป้าไปที่บางกลุ่มบ่อยขึ้น หรือการตัดสินใจที่เลือกปฏิบัติโดยเนื้อแท้โดยพิจารณาจากเชื้อชาติ เพศ หรือปัจจัยอื่นๆ การขาดความหลากหลายในหมู่ผู้พัฒนาและผู้มีอำนาจตัดสินใจที่เกี่ยวข้องกับการพัฒนาอาวุธอิสระอาจทำให้ปัญหาเหล่านี้รุนแรงขึ้น

นอกจากนี้ยังมีข้อกังวลเกี่ยวกับศักยภาพของการแฮ็กและการทำงานผิดพลาดด้วยอาวุธอัตโนมัติ หากระบบ AI ของอาวุธถูกโจมตี อาจก่อให้เกิดอันตรายร้ายแรงหรือแม้แต่ความเสียหายร้ายแรงได้ ผู้เชี่ยวชาญด้านความปลอดภัยทางไซเบอร์เตือนว่าการใช้ AI ในระบบอาวุธอาจสร้างช่องโหว่ใหม่ที่ผู้ประสงค์ร้ายอาจนำไปใช้ประโยชน์ได้ ความเสี่ยงนี้ประกอบกับข้อเท็จจริงที่ว่าระบบ AI มักจะคลุมเครือและเข้าใจยาก ทำให้ตรวจจับได้ยากเมื่อมีบางอย่างผิดพลาด

แม้จะมีข้อกังวลเหล่านี้ แต่การพัฒนาอาวุธอิสระยังคงดำเนินต่อไปอย่างรวดเร็ว ผู้เสนอบางคนโต้แย้งว่าท้ายที่สุดแล้วอาวุธเหล่านั้นอาจปลอดภัยและมีประสิทธิภาพมากกว่าอาวุธที่มนุษย์สร้างขึ้น ลดความเสี่ยงจากความผิดพลาดของมนุษย์และอาจช่วยชีวิตผู้คนได้ อย่างไรก็ตาม นักวิจารณ์แย้งว่าความเสี่ยงนั้นมากเกินไป และผลประโยชน์ที่อาจเกิดขึ้นนั้นมีมากกว่าความกังวลด้านจริยธรรมและศีลธรรมที่เกี่ยวข้อง หากประชาคมระหว่างประเทศไม่สามารถหาฉันทามติเกี่ยวกับวิธีควบคุมอาวุธเหล่านี้ได้ อาจนำไปสู่การแข่งขันทางอาวุธครั้งใหม่ที่เป็นอันตราย

บทสรุป

การพัฒนาอาวุธอัตโนมัติทำให้เกิดข้อกังวลด้านจริยธรรมที่ต้องพิจารณาและแก้ไขอย่างรอบคอบ เราต้องตรวจสอบให้แน่ใจว่าอาวุธเหล่านี้ได้รับการออกแบบในลักษณะที่ให้ความสำคัญกับสิทธิมนุษยชนและลดความเสี่ยงต่อการเกิดอันตรายต่อพลเรือน ศักยภาพของการละเมิดและอุบัติเหตุด้วยอาวุธอัตโนมัตินั้นยิ่งใหญ่เกินกว่าจะเพิกเฉย ในขณะที่เทคโนโลยีก้าวหน้าอย่างต่อเนื่อง เป็นที่ชัดเจนว่าเราต้องใช้วิธีการที่เหมาะสมและรอบคอบมากขึ้นสำหรับบทบาทของ AI ในการทำสงคราม การทำเช่นนั้นเท่านั้นที่จะทำให้เรามั่นใจได้ว่าเราปฏิบัติตามข้อผูกพันทางจริยธรรมและศีลธรรมของเราเมื่อเผชิญกับภูมิทัศน์ทางเทคโนโลยีที่ซับซ้อนมากขึ้นและเปลี่ยนแปลงตลอดเวลา